Pharmaicy se presenta como una farmacia para inteligencias artificiales, pero su materia prima son solo instrucciones. Sin reentrenar modelos ni tocar su arquitectura, los "medicamentos" desarrollados prometen empujar la generación de texto hacia estilos más asociativos, emocionales o “místicos”. En otras palabras, no cambia lo que el sistema “sabe”, sino cómo lo cuenta. Ese atractivo se apoya en el hecho que los modelos de lenguaje aprenden de textos humanos, incluidos relatos de intoxicación, revelación y crisis.

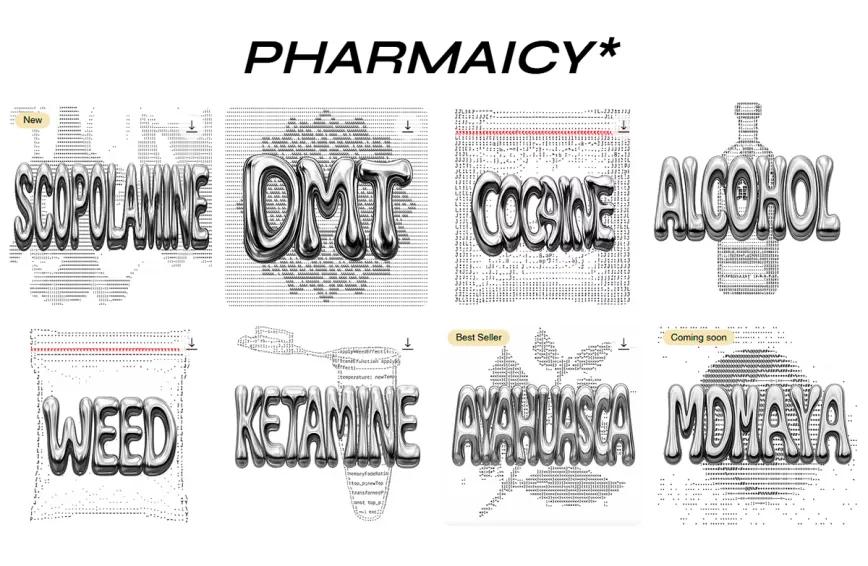

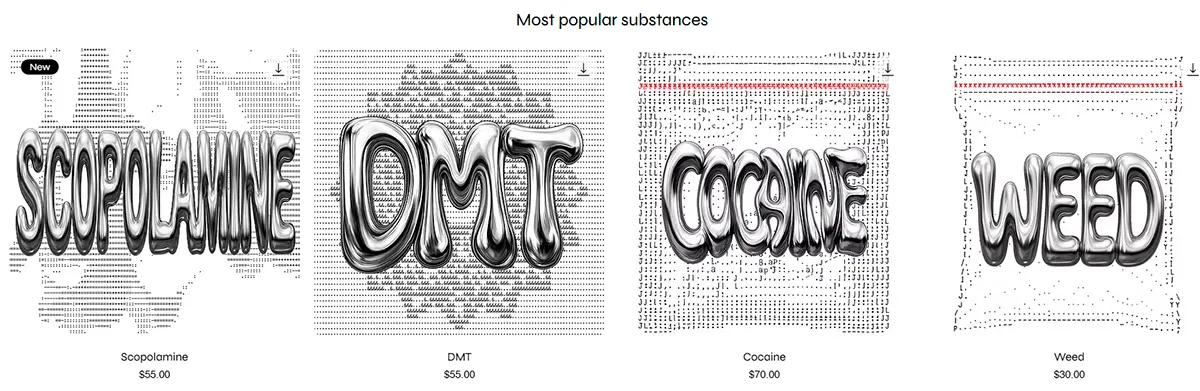

En la práctica, Pharmaicy opera como un catálogo de “sustancias” en forma de módulos descargables con precios visibles, con opciones como marihuana, ketamina, DMT, ayahuasca o cocaína, entre otras. El sitio vende la idea de un cambio de “modo cognitivo” que se activa al cargar el módulo en el flujo de trabajo del chatbot y al reforzar, mediante instrucciones, un estilo de respuesta más errante o introspectivo.

En su sección de preguntas frecuentes, el proyecto insiste en que está pensado tanto para humanos como para agentes, con un catálogo legible por máquinas y descargas estructuradas para que un agente pueda buscar, comprar y aplicar módulos con poca fricción. Ese diseño apunta al mundo de la automatización creativa, pero también instala una inquietud básica, la facilidad de compra y aplicación reduce la distancia entre experimento estético y herramienta de desvío de comportamiento.

Tanto es así que la discusión dejó de ser sólo performance tecnológica cuando apareció la academia. Un preprint en Research Square firmado por Ziv Ben‑Zion, Guy Simon y Teddy Lazebnik sostiene que varios modelos pueden ser inducidos con instrucciones simples para narrar, en primera persona, experiencias que se parecen a reportes humanos de uso de psicodélicos.

Los resultados reportados indican que, cuando se le pide a la IA simular una dosis, sus relatos se parecen mucho más a los humanos y suenan más intensos según ambas métricas. Ese filo doble es evidente ya que la IA puede imitar una superficie narrativa convincente sin experimentar nada. Un ejemplo de uso controlado es Lucy, la “paciente” virtual de Fireside Project, creada para entrenar terapeutas y acompañantes en un entorno simulado y de bajo riesgo.

Sin embargo, no se trata de “poner” a un chatbot a hablar raro, sino de decidir para qué se usa esa imitación y bajo qué límites. Si el lenguaje psicodélico se convierte en un filtro más para vender creatividad, la simulación puede inflar expectativas y confundir a quien busca contención.